O que é PaLM?

Caminhos Modelo de idioma ou PaLMO modelo do Google é um modelo que utiliza uma arquitetura Transformer complicada com 540 bilhões de decodificadores como suas únicas entradas. Ele foi treinado usando o sistema Pathways do Google, que permite que ele gerencie várias tarefas ao mesmo tempo, adquira rapidamente novas habilidades e reflita uma visão mais completa do ambiente. PaLM tem a capacidade de produzir texto em uma variedade de linguagens e formatos, incluindo gráficos, códigos e linguagem natural.

O que é GPT?

Transformador generativo pré-treinado (GPT) é um grupo de Modelos de IA criados pela OpenAI que fazem uso de uma arquitetura Transformer com vários números de parâmetros. Um enorme conjunto de dados multimodais que inclui páginas da Web, livros, fotos, vídeos, podcasts e muito mais foi usado para treinar a versão mais recente, GPT-4, que tem 1,5 trilhão de parâmetros.

Embora precise de mais ajustes para tarefas específicas, o GPT-4 também pode produzir textos em vários idiomas e domínios. UberCriar é uma versão aperfeiçoada dos modelos GPT 3.5 e GPT 4 da OpenAI que executa várias tarefas, como a criação de conteúdo de IA, Geração de código de IA, geração de imagens com IA etc.

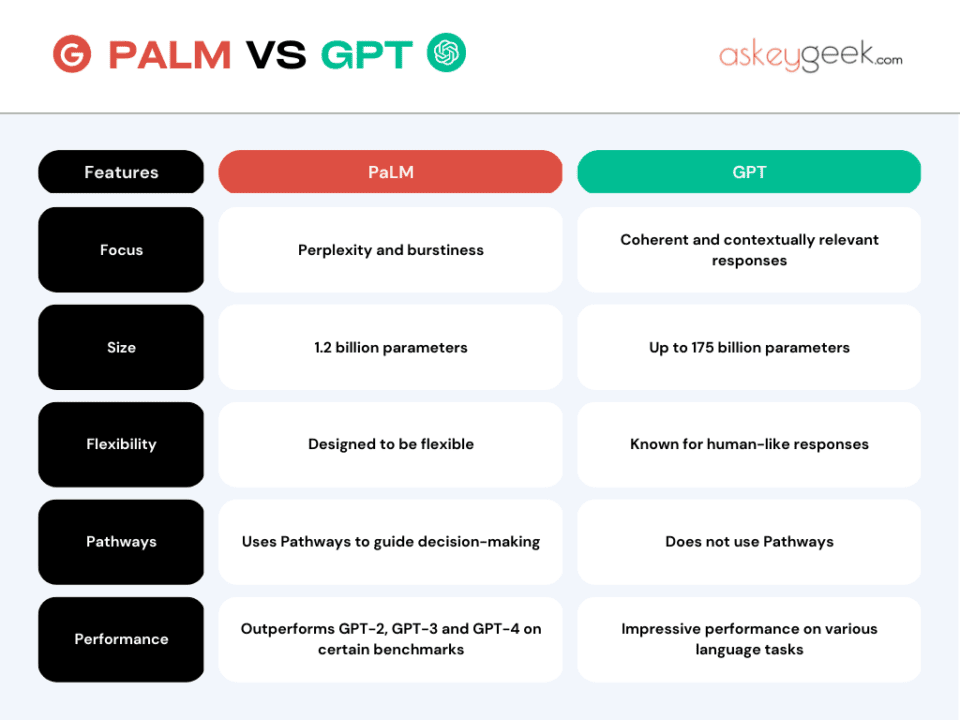

PaLM vs GPT

Tanto o PaLM quanto o GPT são modelos impressionantes que demonstram o poder da modelagem de linguagem e seu potencial para várias aplicações. No entanto, eles também têm algumas diferenças e compensações que exploraremos a seguir na tabela de comparação de recursos PaLM vs. GPT.

Principais recursos do PaLM

- Perplexidade e agitação

- 1,2 bilhão de parâmetros

- Projetado para ser flexível

- Usa o Pathways para orientar a tomada de decisões

- Supera o desempenho do GPT-2 e do GPT-3 em determinados benchmarks

Principais recursos do GPT

- Respostas coerentes e contextualmente relevantes

- Até 175 bilhões de parâmetros

- Conhecido por respostas semelhantes às humanas

- Não usa o Pathways

- Desempenho impressionante em várias tarefas linguísticas

Escalabilidade do PaLM e do GPT

O PaLM tem um número menor de parâmetros do que o GPT-4, mas usa uma estratégia de paralelismo mais eficiente e uma reformulação do bloco Transformer que permite treinamento e inferência mais rápidos. O PaLM alcançou uma utilização de FLOPs de hardware de 57,8%, a mais alta já obtida para LLMs nessa escala.

O GPT-4, por outro lado, usa mais dados e recursos de computação para treinar seu modelo maior, o que pode limitar sua escalabilidade e acessibilidade.

Versatilidade do PaLM e do GPT

Tanto o PaLM quanto o GPT-4 podem gerar texto em vários idiomas e domínios, mas o PaLM tem uma vantagem em termos de versatilidade devido ao seu sistema Pathways. O PaLM pode aproveitar o conhecimento e as habilidades existentes para aprender novas tarefas de forma rápida e eficaz, utilizando e combinando seus caminhos. Por exemplo, o PaLM pode gerar código a partir de descrições de linguagem natural ou imagens sem nenhum ajuste fino.

O GPT-4, por outro lado, exige um ajuste mais fino para tarefas ou domínios específicos, o que pode reduzir sua capacidade de generalização e aumentar sua dependência de dados.

Desempenho do PaLM e do GPT

Tanto o PaLM quanto o GPT-4 alcançam o desempenho mais avançado em centenas de tarefas de compreensão e geração de linguagem em diferentes domínios. No entanto, o PaLM supera o GPT-4 na maioria das tarefas por margens significativas em muitos casos.

Por exemplo, o PaLM alcança maior precisão do que o GPT-4 em tarefas de inferência de linguagem natural (NLI), resposta a perguntas (QA), sumarização (SUM), análise de sentimentos (SA), tradução automática (MT), legendagem de imagens (IC), geração de código (CG) e conclusão de código (CC). Além disso, o PaLM libera novos recursos que o GPT-4 não tem, como a geração de textos longos coerentes ou resultados multimodais.

Infográficos sobre PaLM vs GPT

Aqui está uma tabela que resume as diferenças entre o PaLM e o GPT:

Pino

Pino